陈鸿龙教授团队在人工智能安全方面取得进展,相关研究成果Black-Box Adversarial Defense Based on Image Decomposition and Reconstruction发表在《IEEE Transactions on Multimedia》。《IEEE Transactions on Multimedia》是计算机视觉领域的国际知名期刊,目前影响因子为8.4(SCI一区)。论文第一作者为余继淼,通讯作者为陈鸿龙教授,BB贝博艾弗森为唯一署名单位和通讯单位,该研究得到山东省自然科学基金(项目编号:ZR2022YQ61)的资助支持。

图1 论文首页

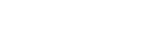

近年来对抗性攻击对深度神经网络(DNN)的安全性构成了挑战,其中最突出的对抗性攻击方法包括后门攻击、对抗样本等,攻击者将触发器或扰动以不同方式注入图像中,导致深度学习领域出现极其危险的安全漏洞。对抗攻击的复杂性给设计通用防御策略带来了巨大挑战。在本文中,提出一种新颖的防御方法,通过图像分解与重构(IDR)来抵御大多数对抗性攻击。该方法应用于中毒图像,无需其他了解模型的信息,也无需任何关于图像的先验知识。同时,本文对图像应用线性变换以破坏扰动或触发器,并部署预训练的扩散模型来重建原始信息,在这个过程中提出一种新颖的逆向过程,利用范围-零空间分解的一致性来指导纯净图像的生成。范围-零空间的分解可以保证图像信息的恢复,从而增强了方法的鲁棒性,并有助于被污染图像的可靠净化。本文评估了所提出的IDR方法针对各种流行的后门攻击、对抗样本和图像缩放攻击方法的有效性。实验结果突显了所提出IDR方法出色的防御能力,显示出极高的防御成功率。

图2 IDR对抗防御策略

论文链接:https://doi.org/10.1109/TMM.2025.3565987

实验教学平台

实验教学平台 集团OA系统

集团OA系统 集团邮件系统

集团邮件系统 相关文件查询

相关文件查询