近日,公司刘伟锋教授团队在人工智能领域取得重要进展,两篇研究论文被人工智能领域国际顶级会议AAAI 2026收录,分别聚焦于大模型上下文学习泛化分析和3D视觉-语言模型高效压缩两个前沿方向。

在大模型上下文学习泛化分析方向,团队完成的《Towards Understanding In-Context Learning of Transformers under Non-i.i.d. Scenarios》入选AAAI会议,公司王英杰为第一作者,中国石油大学(华东)为第一署名单位。随着大型语言模型的出现,人工智能在语言理解和复杂推理任务上取得了革命性进展。其中,上下文学习能力成为Transformer模型的重要特性之一。上下文学习允许模型在不更新参数的情况下,通过少量示例完成新任务,展现了强大的灵活性与泛化能力。然而,现有的大多数理论分析都建立在独立同分布假设之上,而在真实应用中,提示词中的示例往往存在分布相关性或序列结构性,使得传统分析难以解释模型在非i.i.d.场景下的泛化规律。因此,建立一个能刻画Transformer在非i.i.d.环境中上下文学习行为的统一理论框架,具有重要的理论与实践意义。本文受梯度优化视角的启发,提出了一种基于梯度稳定性理论的Transformer ICL 泛化框架。研究首先建立了上下文学习过程与梯度下降优化之间的理论等价关系,并在此基础上,引入基于算法稳定性的泛化分析方法,从而在无分布假设的条件下推导出上下文学习的泛化误差上界。

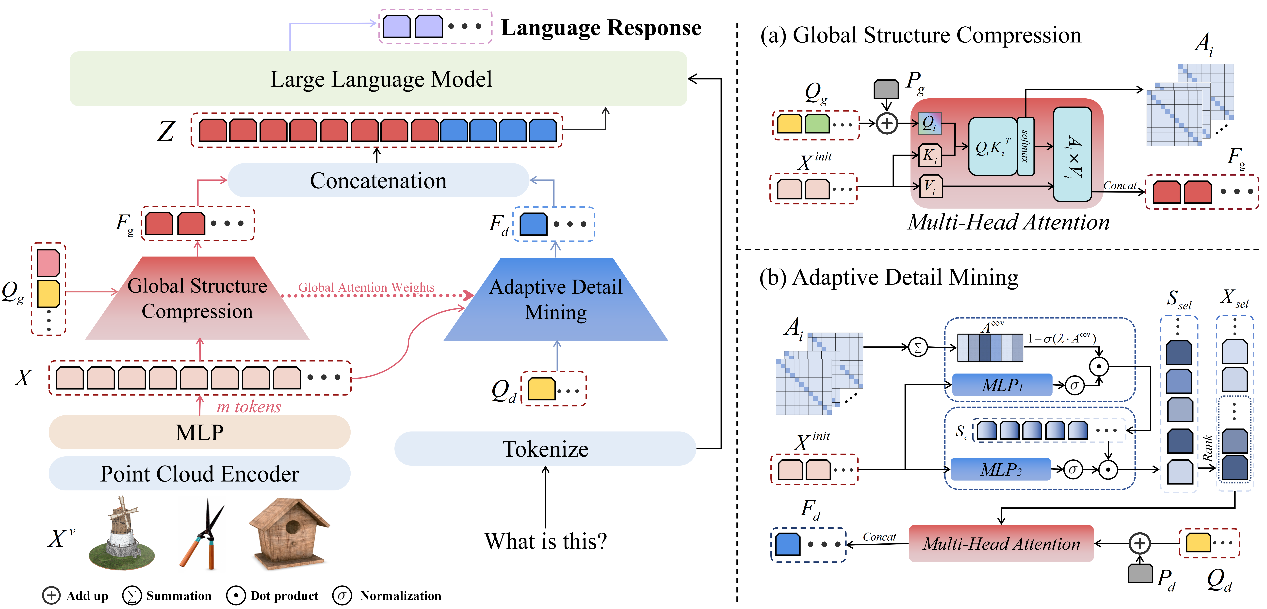

在3D视觉-语言模型高效压缩方向,团队与香港理工大学合作完成的《HCC-3D: Hierarchical Compensatory Compression for 98% 3D Token Reduction in Vision-Language Models》实现了高效人工智能与3D视觉理解的创新结合。公司张冰峰副教授为通讯作者,2024级硕士生张立恒为第一作者,中国石油大学(华东)为第一署名单位。3D视觉理解在人工智能领域具有重要应用价值,当前3D视觉-语言模型能够实现点云数据与文本的多模态推理,然而现有方法面临巨大的计算开销限制其实际应用。研究发现计算瓶颈主要在于大语言模型需要处理大量的3D视觉tokens,由于点云数据的不规则分布导致信息密度不均,简单的token压缩往往会造成严重的性能下降。为此,团队提出了层次化补偿压缩方法(HCC-3D),采用全局结构压缩(GSC)和自适应细节挖掘(ADM)的双路径架构。GSC使用可学习的3D空间查询通过多头注意力机制实现整体压缩并保留基本几何结构,ADM则通过注意力引导的选择机制动态识别被全局压缩忽略但信息丰富的区域,并使用专门的细节查询进行再压缩。这种分层设计使HCC-3D能够将3D特征压缩至仅12个tokens,实现约98%的压缩率,相比现有方法显著减少了训练时间,同时层次化互补机制有效降低了压缩过程中的信息损失,在多个下游任务中保持了高质量表现。

AAAI是人工智能领域最具影响力的国际学术会议之一,与IJCAI并列为人工智能领域两大顶级综合性会议,是中国计算机学会(CCF)推荐的A类国际学术会议。AAAI 2026会议论文录用率约为17.6%,体现了该会议的高学术水准和严格的评审标准。

刘伟锋教授团队研究方向主要为机器学习、人工智能、智能信息处理算法等。现有教授1人,副教授3人,讲师4人。团队的青年人才培养工作近两年取得很大进展,2022年至今团队青年教师已经获得国家自然基金青年基金4项,山东省海外优青1项,山东省泰山学者青年专家1项等多个国家和省级项目。此外,团队青年教师已经多次在IEEE TPAMI、IEEE TIP、IEEE TKDE、ICML、ICLR、CVPR、AAAI、IJCAI等人工智能顶级期刊和会议发表相关研究工作,受到领域的广泛关注。

实验教学平台

实验教学平台 集团OA系统

集团OA系统 集团邮件系统

集团邮件系统 相关文件查询

相关文件查询